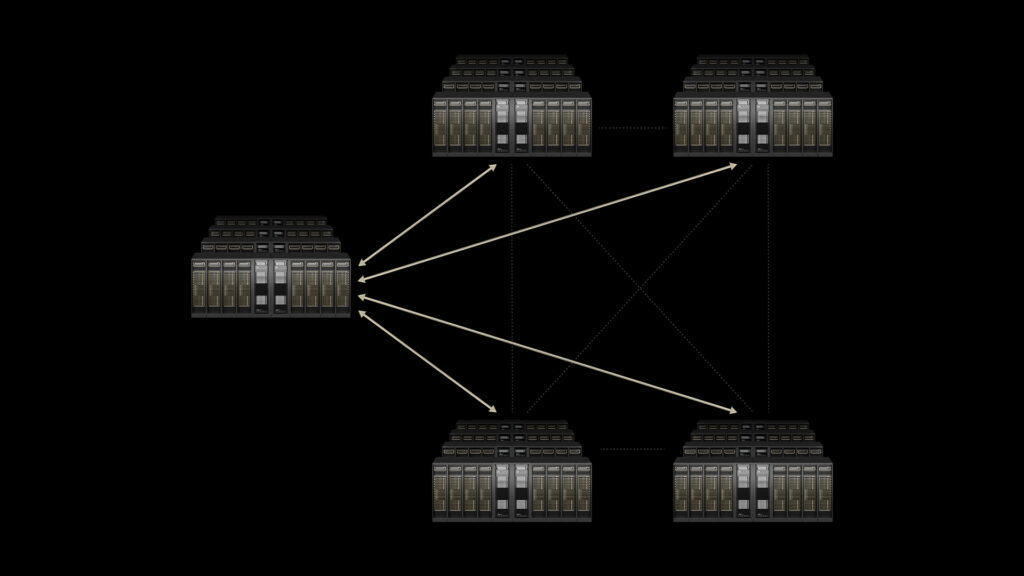

Lorsque les centres de données IA manquent d’espace, ils sont confrontés à un dilemme coûteux: construire des installations plus grandes ou trouver des moyens de faire fonctionner plusieurs emplacements ensemble. La dernière technologie Ethernet Spectrum-XGS de NVIDIA promet de résoudre ce défi en connectant les centres de données d’IA sur de grandes distances dans ce que l’entreprise appelle les «super-factories d’IA à l’échelle de Giga».

Annoncé avant Hot Chips 2025, cette innovation de réseautage représente la réponse de l’entreprise à un problème croissant qui forçait l’industrie de l’IA à repenser la répartition de la puissance informatique.

Le problème: quand un bâtiment ne suffit pas

À mesure que les modèles d’intelligence artificielle deviennent plus sophistiqués et exigeants, ils nécessitent une puissance de calcul énorme qui dépasse souvent ce que toute installation peut fournir. Les centres de données d’IA traditionnels sont confrontés à des contraintes de capacité électrique, d’espace physique et de capacités de refroidissement.

Lorsque les entreprises ont besoin de plus de puissance de traitement, elles doivent généralement construire des installations entièrement nouvelles – mais coordonner le travail entre des emplacements distincts a été problématique en raison de limitations de réseautage. Le problème réside dans l’infrastructure Ethernet standard, qui souffre de latence élevée, des fluctuations de performances imprévisibles (appelées «gigue») et des vitesses de transfert de données incohérentes lors de la connexion des emplacements éloignés.

Ces problèmes rendent difficile pour les systèmes d’IA de distribuer efficacement des calculs complexes sur plusieurs sites.

Solution de Nvidia: Technologie Scale-Across

Spectrum-XGS Ethernet introduit ce que NVIDIA terme la capacité de «réduction de l’échelle-across» – une troisième approche de l’informatique en IA qui complète la «mise à l’échelle» existante (rendant les processeurs individuels plus puissants) et la «mise à l’échelle» (ajoutant plus de processeurs dans le même emplacement).

La technologie s’intègre dans la plate-forme Ethernet Spectrum-X existante de NVIDIA et comprend plusieurs innovations clés:

- Algorithmes adaptatifs à distance qui ajustent automatiquement le comportement du réseau en fonction de la distance physique entre les installations

- Contrôle de congestion avancée qui empêche les goulots d’étranglement des données pendant la transmission longue distance

- Gestion de la latence de précision Pour assurer des temps de réponse prévisibles

- Télémétrie de bout en bout pour la surveillance et l’optimisation du réseau en temps réel

Selon l’annonce de Nvidia, ces améliorations peuvent «presque doubler les performances de la bibliothèque de communications collectives NVIDIA», qui gère la communication entre plusieurs unités de traitement graphique (GPU) et les nœuds informatiques.

Implémentation du monde réel

Coreweave, une société d’infrastructure cloud spécialisée dans l’informatique accélérée par le GPU, prévoit d’être parmi les premiers adoptants de Spectrum-XGS Ethernet.

« Avec Nvidia Spectrum-XGS, nous pouvons connecter nos centres de données à un seul supercalculateur unifié, donnant à nos clients l’accès à une IA à l’échelle de Giga qui accélérera les percées dans chaque industrie », a déclaré Peter Salanki, cofondateur de Corewave et directeur de la technologie.

Ce déploiement servira de cas de test pratique pour savoir si la technologie peut tenir ses promesses dans des conditions réelles.

Contexte et implications de l’industrie

L’annonce fait suite à une série de versions axées sur le réseautage de NVIDIA, y compris la plate-forme Spectrum-X originale et les commutateurs photoniques de silicium Quantum-X. Ce modèle suggère que l’entreprise reconnaît l’infrastructure de mise en réseau comme un goulot d’étranglement critique dans le développement de l’IA.

« La révolution industrielle de l’IA est là, et les usines d’IA à l’échelle géante sont l’infrastructure essentielle », a déclaré Jensen Huang, fondateur et PDG de Nvidia, dans le communiqué de presse. Bien que la caractérisation de Huang reflète la perspective marketing de Nvidia, le défi sous-jacent qu’il décrit – la nécessité de plus de capacité de calcul – est reconnue dans l’industrie de l’IA.

La technologie pourrait potentiellement avoir un impact sur la façon dont les centres de données de l’IA sont planifiés et exploités. Au lieu de construire des installations uniques massives qui rédigent les réseaux électriques locaux et les marchés immobiliers, les entreprises pourraient distribuer leur infrastructure sur plusieurs emplacements plus petits tout en maintenant des niveaux de performance.

Considérations et limitations techniques

Cependant, plusieurs facteurs pourraient influencer l’efficacité pratique de Spectrum-XGS Ethernet. Les performances du réseau sur de longues distances restent soumises à des limitations physiques, y compris la vitesse de la lumière et la qualité de l’infrastructure Internet sous-jacente entre les emplacements. Le succès de la technologie dépendra en grande partie de la façon dont il peut fonctionner dans ces contraintes.

De plus, la complexité de la gestion des centres de données d’IA distribués s’étend au-delà de la mise en réseau pour inclure la synchronisation des données, la tolérance aux pannes et la conformité réglementaire dans différentes juridictions – les calennes que les améliorations de mise en réseau ne peuvent pas résoudre.

Disponibilité et impact sur le marché

NVIDIA déclare que Spectrum-XGS Ethernet est «disponible maintenant» dans le cadre de la plate-forme Spectrum-X, bien que les calendriers de déploiement et spécifiques n’aient pas été divulgués. Le taux d’adoption de la technologie dépendra probablement de la rentabilité par rapport aux approches alternatives, telles que la construction d’installations monocoles plus grandes ou l’utilisation de solutions de réseautage existantes.

L’essentiel pour les consommateurs et les entreprises est la suivante: si la technologie de Nvidia fonctionne comme promise, nous pourrions voir des services d’IA plus rapides, des applications plus puissantes et des coûts potentiellement réduits à mesure que les entreprises acquièrent l’efficacité grâce à l’informatique distribuée. Cependant, si la technologie ne parvient pas à livrer dans des conditions réelles, les sociétés d’IA continueront de faire face au choix coûteux entre construire des installations uniques toujours plus grandes ou accepter des compromis de performance.

Le déploiement à venir de Corewave servira de premier test majeur pour savoir si la connexion des centres de données d’IA sur les distances peut vraiment fonctionner à grande échelle. Les résultats détermineront probablement si d’autres sociétés suivent le pas ou s’en tiennent à des approches traditionnelles. Pour l’instant, Nvidia a présenté une vision ambitieuse, mais l’industrie de l’IA attend toujours de voir si la réalité correspond à la promesse.