Les pirates informatiques parrainés par l’État exploitent des outils très avancés pour accélérer leurs types particuliers de cyberattaques, les acteurs menaçants d’Iran, de Corée du Nord, de Chine et de Russie utilisant des modèles comme Gemini de Google pour poursuivre leurs campagnes. Ils sont capables de concevoir des campagnes de phishing sophistiquées et de développer des logiciels malveillants, selon un nouveau rapport du Threat Intelligence Group (GTIG) de Google.

Le rapport trimestriel AI Threat Tracker, publié aujourd’hui, révèle comment les attaquants soutenus par le gouvernement ont commencé à utiliser l’intelligence artificielle dans le cycle de vie des attaques : reconnaissance, ingénierie sociale et, éventuellement, développement de logiciels malveillants. Cette activité s’est concrétisée grâce aux travaux du GTIG au cours du dernier trimestre 2025.

« Pour les auteurs de menaces soutenus par le gouvernement, les grands modèles linguistiques sont devenus des outils essentiels pour la recherche technique, le ciblage et la génération rapide de leurres de phishing nuancés », ont déclaré les chercheurs du GTIG dans leur rapport.

Une reconnaissance par des hackers parrainés par l’État cible le secteur de la défense

L’acteur iranien APT42 aurait utilisé Gemini pour renforcer ses opérations de reconnaissance et d’ingénierie sociale ciblées. Le groupe a utilisé une IA pour créer des adresses e-mail d’apparence officielle pour des entités spécifiques, puis a mené des recherches pour établir des prétextes crédibles pour approcher des cibles.

APT42 a créé des personnages et des scénarios conçus pour mieux susciter l’engagement de leurs cibles, en traduisant entre les langues et en déployant des expressions naturelles et natives qui l’ont aidé à contourner les signaux d’alarme traditionnels du phishing, tels qu’une mauvaise grammaire ou une syntaxe maladroite.

L’acteur UNC2970, soutenu par le gouvernement nord-coréen, qui se concentre sur le ciblage de la défense et l’usurpation d’identité de recruteurs d’entreprise, a utilisé Gemini pour l’aider à profiler des cibles de grande valeur. La reconnaissance du groupe comprenait la recherche d’informations sur les principales entreprises de cybersécurité et de défense, la cartographie des postes techniques spécifiques et la collecte d’informations sur les salaires.

« Cette activité brouille la distinction entre la recherche professionnelle de routine et la reconnaissance malveillante, car l’acteur rassemble les éléments nécessaires pour créer des personnages de phishing sur mesure et haute fidélité », a noté GTIG.

Les attaques par extraction de modèles se multiplient

Au-delà des abus opérationnels, Google DeepMind et GTIG ont identifié une augmentation des tentatives d’extraction de modèles – également connues sous le nom d’« attaques par distillation » – visant à voler la propriété intellectuelle des modèles d’IA.

Une campagne ciblant les capacités de raisonnement de Gemini impliquait la collecte et l’utilisation de plus de 100 000 invites conçues pour contraindre le modèle à produire des processus de raisonnement. L’étendue des questions suggérait une tentative de reproduire la capacité de raisonnement des Gémeaux dans des langues cibles autres que l’anglais dans diverses tâches.

Bien que GTIG n’ait observé aucune attaque directe sur les modèles frontières de la part d’acteurs de menaces persistantes avancées, l’équipe a identifié et perturbé les attaques fréquentes d’extraction de modèles émanant d’entités du secteur privé à l’échelle mondiale et de chercheurs cherchant à cloner une logique propriétaire.

Les systèmes de Google ont reconnu ces attaques en temps réel et déployé des défenses pour protéger les traces de raisonnement interne.

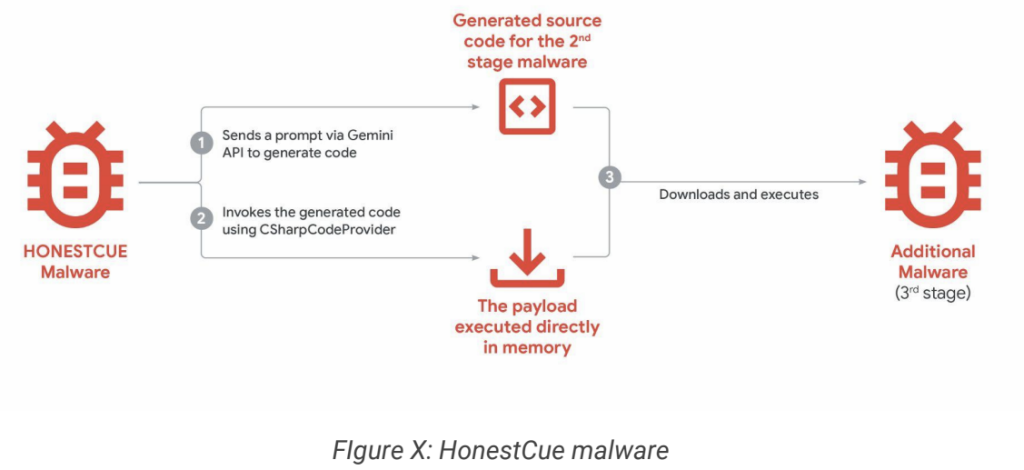

Un malware intégré à l’IA apparaît

GTIG a observé des échantillons de logiciels malveillants, suivis sous le nom de HONESTCUE, qui utilisent l’API de Gemini pour externaliser la génération de fonctionnalités. Le malware est conçu pour saper la détection réseau et l’analyse statique traditionnelles grâce à une approche d’obscurcissement à plusieurs niveaux.

HONESTCUE fonctionne comme un framework de téléchargement et de lancement qui envoie des invites via l’API de Gemini et reçoit le code source C# en réponse. L’étape secondaire sans fichier compile et exécute les charges utiles directement en mémoire, ne laissant aucun artefact sur le disque.

Par ailleurs, GTIG a identifié COINBAIT, un kit de phishing dont la construction a probablement été accélérée par les outils de génération de code d’IA. Le kit, qui se fait passer pour un échange majeur de crypto-monnaie pour la collecte d’informations d’identification, a été construit à l’aide de la plate-forme Lovable AI, basée sur l’IA.

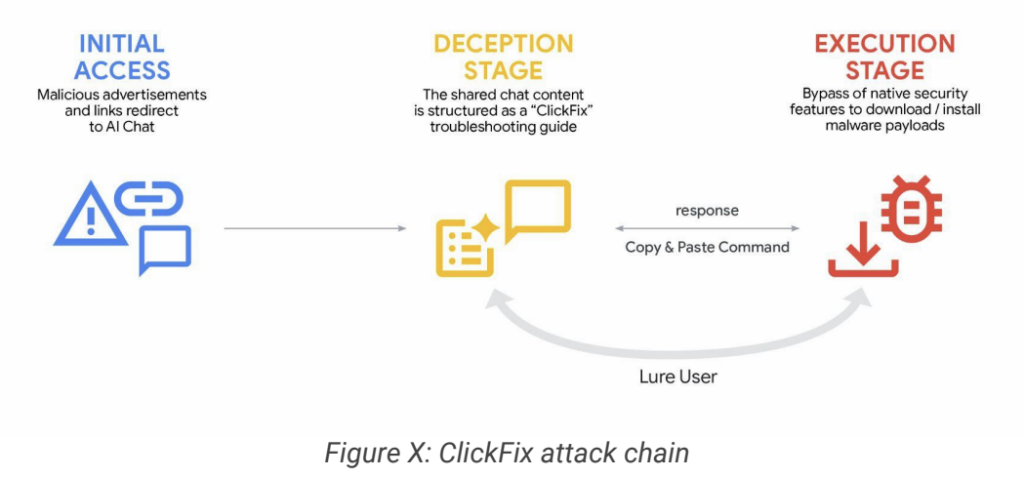

Les campagnes ClickFix abusent des plateformes de chat IA

Dans une nouvelle campagne d’ingénierie sociale observée pour la première fois en décembre 2025, Google a vu des acteurs malveillants abuser des fonctionnalités de partage public des services d’IA générative – notamment Gemini, ChatGPT, Copilot, DeepSeek et Grok – pour héberger du contenu trompeur distribuant des logiciels malveillants ATOMIC ciblant les systèmes macOS.

Les attaquants ont manipulé des modèles d’IA pour créer des instructions réalistes pour les tâches informatiques courantes, en intégrant des scripts de ligne de commande malveillants comme « solution ». En créant des liens partageables vers ces transcriptions de discussions IA, les acteurs malveillants ont utilisé des domaines de confiance pour héberger leur phase d’attaque initiale.

Le marché clandestin prospère grâce aux clés API volées

Les observations du GTIG sur les forums clandestins en anglais et en russe indiquent une demande persistante d’outils et de services basés sur l’IA. Cependant, les pirates informatiques et les cybercriminels parrainés par l’État ont du mal à développer des modèles d’IA personnalisés, s’appuyant plutôt sur des produits commerciaux matures accessibles via des informations d’identification volées.

Une boîte à outils, « Xanthorox », se présente comme une IA personnalisée pour la génération autonome de logiciels malveillants et le développement de campagnes de phishing. L’enquête du GTIG a révélé que Xanthorox n’était pas un modèle sur mesure mais qu’il était en réalité alimenté par plusieurs produits commerciaux d’IA, dont Gemini, accessibles via des clés API volées.

Réponse et mesures d’atténuation de Google

Google a pris des mesures contre les acteurs malveillants identifiés en désactivant les comptes et les actifs associés à des activités malveillantes. La société a également appliqué l’intelligence pour renforcer à la fois les classificateurs et les modèles, leur permettant de refuser toute assistance lors d’attaques similaires à l’avenir.

« Nous nous engageons à développer l’IA de manière audacieuse et responsable, ce qui signifie prendre des mesures proactives pour perturber les activités malveillantes en désactivant les projets et les comptes associés aux mauvais acteurs, tout en améliorant continuellement nos modèles pour les rendre moins susceptibles d’être utilisés à mauvais escient », indique le rapport.

Le GTIG a souligné que malgré ces développements, aucun acteur des APT ou des opérations d’information n’a atteint des capacités révolutionnaires qui modifient fondamentalement le paysage des menaces.

Les résultats soulignent le rôle évolutif de l’IA dans la cybersécurité, alors que les défenseurs et les attaquants se précipitent pour utiliser les capacités de la technologie.

Pour les équipes de sécurité des entreprises, en particulier dans la région Asie-Pacifique où les pirates informatiques parrainés par les États chinois et nord-coréens restent actifs, le rapport constitue un rappel important pour renforcer les défenses contre les opérations d’ingénierie sociale et de reconnaissance renforcées par l’IA.

(Photo par les œuvres d’art SCARECROW)